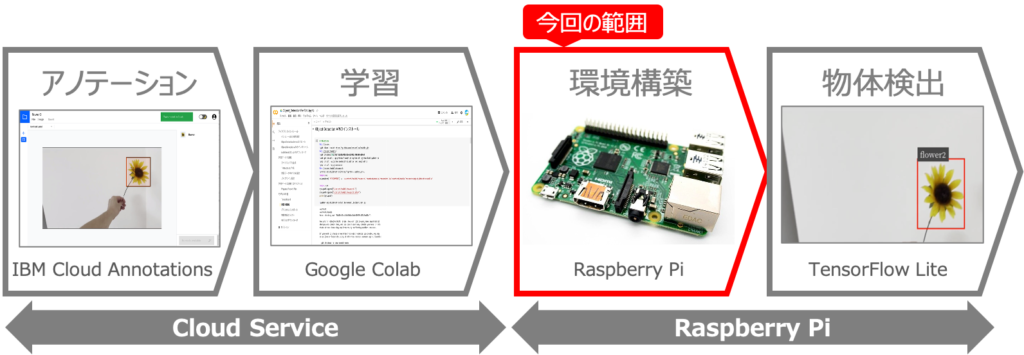

はじめに

オリジナルモデルを使った物体検出をRaspberry Piで行うべく、以下を実現しようとしています。

これを実現するために4回に分けて記事を記載予定で、今回は3つ目の記事です。

第1回:IBM Cloud Annotationsを用いたアノテーション

第2回:Google Colabを用いたモデルの学習

第3回:Raspberry Piの環境構築 ←この記事

第4回:オリジナルモデルを用いた物体検出

第3回:Raspberry Piの環境構築

前回は無料でGPUを使えるGoogle Colabを使って、TensorFlowのモデルを学習する事をやってみました。今回は、物体検出に必要なソフトウェアをRaspberry Piにインストールしていきます。TensorFlowは開発が早いので、各種ライブラリのバージョンを合わせてインストールする事がポイントです。

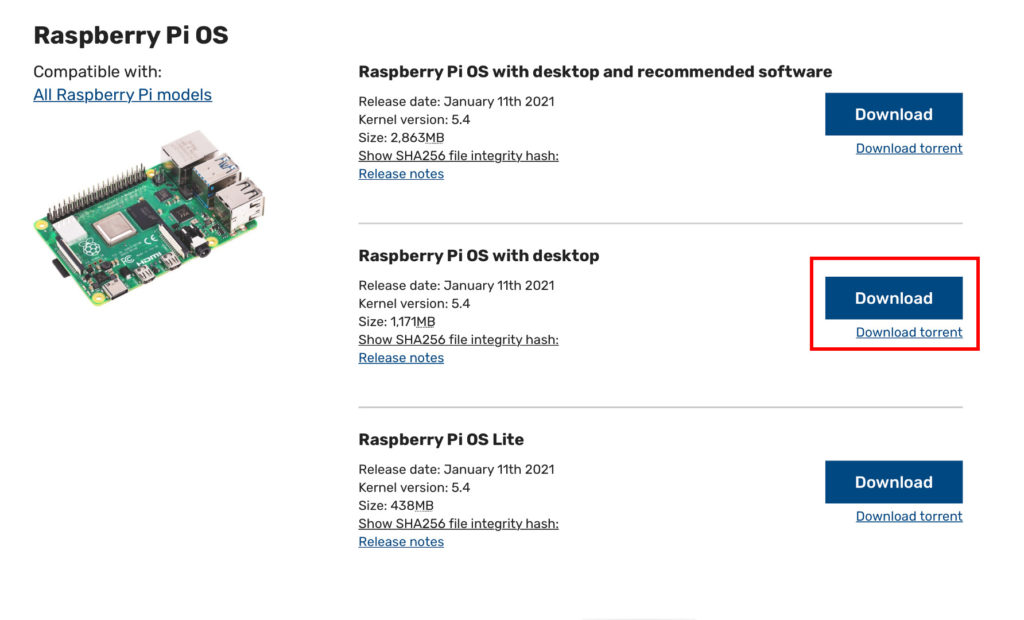

Raspberry Pi OSのインストール

まずは、Raspberry PiにOSをインストールしていきます。Raspberry Pi OSのインストール方法はあちこちに情報がありますので、さくさくいきますね。今回は執筆時点で最新版の2021年1月11日版のRaspberry Pi OS with desktopを利用しました。

①OSイメージのダウンロード

最近はRaspberry Pi Imagerを使うのが良いらしいですが、ダウンロードが途中で止まったりなど、私はあまり好きではないので、昔ながらのWebサイトからイメージをダウンロードする方法でインストールします。

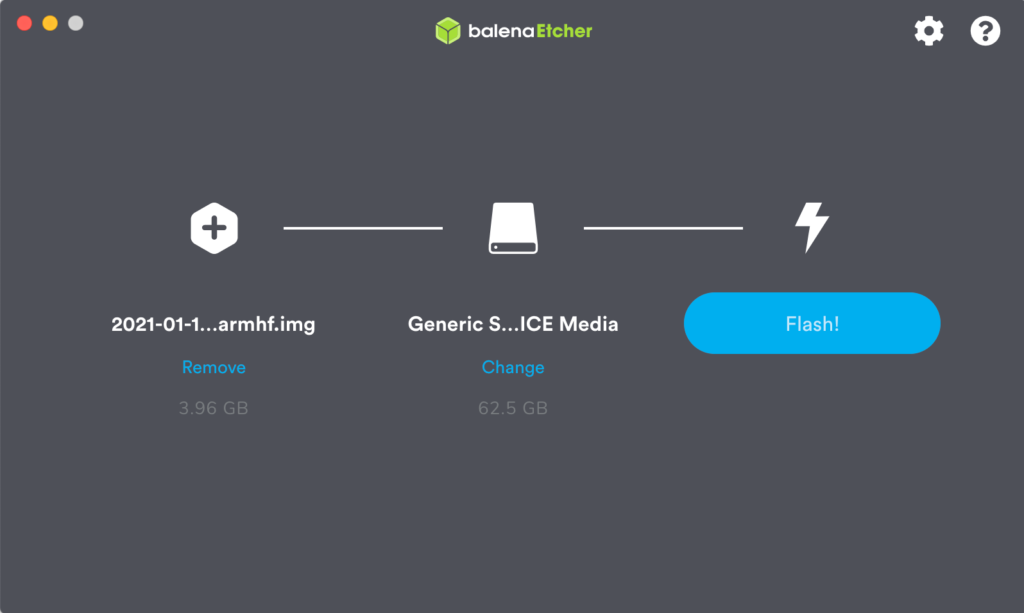

②OSイメージの書き込み

OSイメージは、balenaEtcherでSDカードに書き込みましょう!

③初期設定

OSイメージをSDカードに書き込んだら、Raspberry Piに挿して起動して、Wifiやローケールなどの初期設定を行います。この辺りは、まあいつもの作業って感じですよね?

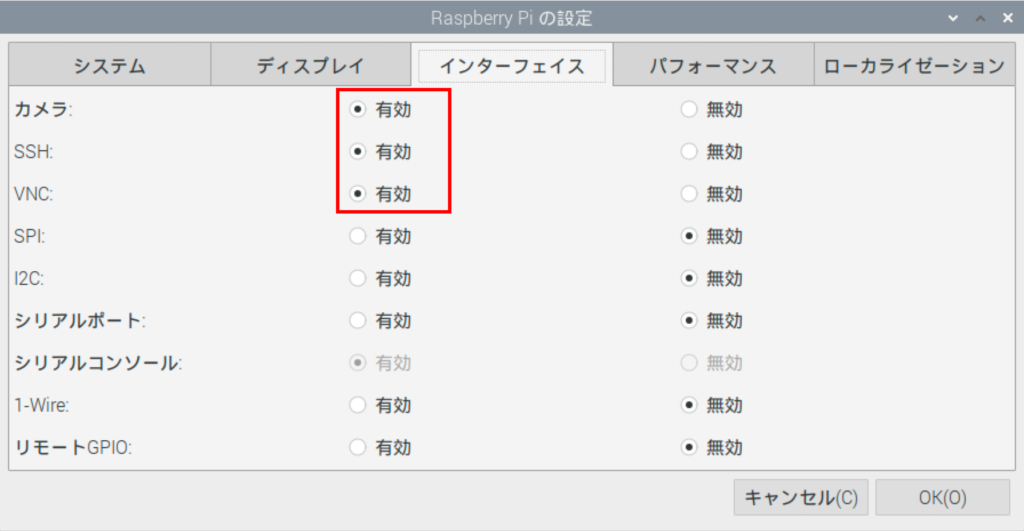

④SSH・VNC・カメラの有効化

Raspberry Pi OSが起動できるようになったら、raspi-configを用いて、外部から接続するためにSSH、VNCを有効にします。ついでに、カメラも有効化しておきましょう‼️

※当然ですが、Raspberry Piにカメラモジュールを挿しておいて下さい。

以上で、Raspberry Pi OSのインストールは完了です。

TensorFlow Lite等のインストール

ここからは、物体検出に必要なTensorFlow Liteなどのソフトウェアをインストールしていきます。

①TensorFlowのインストール

まずは、今回の主役のTensorFlowをインストールします。TensorFlowは、バージョンがどんどん上がっていますが、バージョン差異で良くハマります。ですので、バージョンを指定して1.14系をインストールしましょう。インストールには10分程度かかるので、気長に待ちます☕️

②TensorFlow Liteアプリのクローン

TensorFlow Liet用のアプリは自分で作成しても良いのですが、ここは先人の知恵を使ってサクサクいきたいと思います。今回は「EdjeElectronics」さんの「TensorFlow-Lite-Object-Detection-on-Android-and-Raspberry-Pi」を利用していきます。ありがとうございます😊

以下のようにしてGithub上のファイルをクローンします。またフォルダ名が長いので「tflite」に変更しておきましょう。

③必要ライブラリのインストール

次にTensorFlow Liteアプリの実行に必要なライブラリをインストールします。インストールは簡単で「get_pi_requirements.sh」を実行するだけです。

④モデルファイルのダウンロード

最後に物体検出のテストを行うために、学習済のモデルファイルをダウンロードします。ダウンロードが完了したら、解凍先ディレクトリを指定して、zipファイルを解凍しましょう。ここで「detect.tflite」というファイルが学習済モデルです。また「labelmap.txt」は、物体名を格納したファイルです。

以上でTensorFlow Lite等のインストールは完了です。

物体検出のテスト

ここからは、いよいよRaspberry Piを用いた物体検出をやっていきます‼️

①VNCでRaspberry Piへログイン

物体検出のアプリを起動すると画面に物体検出の様子が表示されるので、VNCでのログインが必要です。PCでVNC Viewerを起動して、Raspberry PiへVNC接続します。

②物体検出のテスト

VNC上でターミナルを立ち上げ、以下のようにしてTensorFlow Liteのアプリを起動します。「modeldir=」パラメータには、先ほどモデルを解凍したフォルダを指定して下さい。

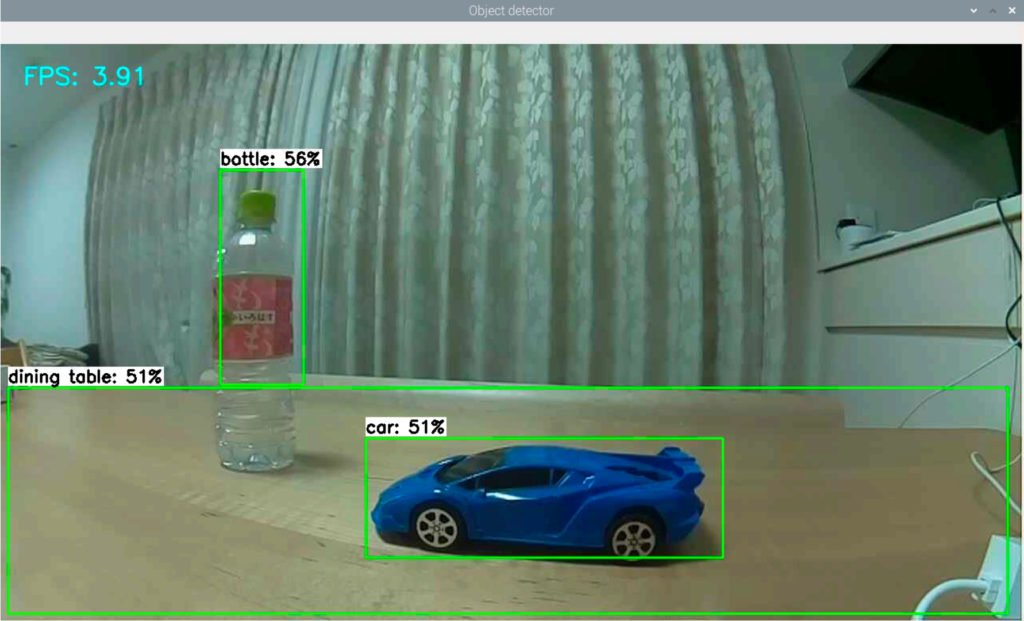

すると以下のようにカメラで撮影した画像に対して、物体検出を行い画面に表示してくれます‼️

おもちゃの車もペットボトルもテーブルもちゃんと認識していますね‼️

おわりに

今回はRaspberry PiにOSやTensorFlowなどのソフトウェアをインストールし、ダウンロードした学習済のモデルを用いてTensorFlow Liteによる物体検出を行いました。次回はいよいよ最終回。自分で学習させたモデルを用いて物体検出を行ってみたいと思います。

第1回:IBM Cloud Annotationsを用いたアノテーション

第2回:Google Colabを用いたモデルの学習

第3回:Raspberry Piの環境構築

第4回:オリジナルモデルを用いた物体検出 ←次の記事

関連記事

コメント